DeepSeek是什么鬼?它怎么就干翻了ChatGPT?

年前年后,DeepSeek悄无声息地登顶中美App Store免费榜第一,甚至碾压了ChatGPT、Google Gemini等一众老牌AI霸主,成为全球AI用户的新宠儿。

类AI对话工具层出不穷,但在实际使用过程中,往往难以获得自己期望的结果,甚至在某些情况下,使用AI反而降低了工作效率

??????

可是

DeepSeek

你真的用对了么

1、它用起来和其他大预言对话模型有什么区别?

2、使用DeepSeek提示词重要么?

3、DeepSeek回答总是很抽象,不尽人意怎么办?

4、深度思考怎么用,如何用对这个“王炸”?

本期“智在青年”专栏将从DeepSeek的独特优势出发,通过案例解析全面分享DeepSeek提问技巧、深度思考技能、使用误区等进行全面解答

一定要打开深度思考么?

当你只想问一些简单的问题或者要完成一些简单的需求任务时

必然追求简单快速且准确的回答是你首要考虑,这时候不必打开“深度思考”,使用默认模型V3即可满足需求

当你需要完成更复杂的任务,想内容更结构化和逻辑清晰时,你应该打开“深度思考R1”选项,优先考虑打开“深度思考”

使用Deepseek需要学习大量提示词么?

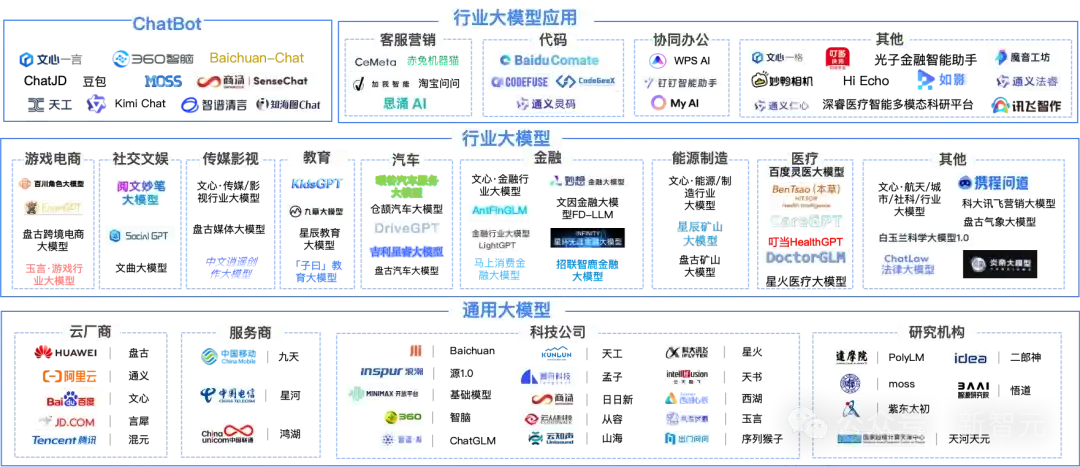

在揭晓答案之前,需要首先明白Deepseek与此前常规的其他大预言模型的区别

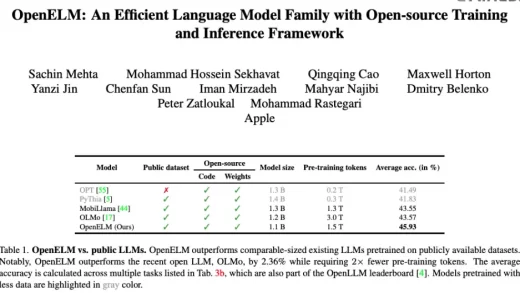

指令模型(例GPT-4o、DeepSeek V3):专门设计用于遵循指令生成内容或执行任务,需要通过提示词的各类技巧才能激发模型更好的表现

推理模型(例DeepSeek R1、OpenAI o1):专注于逻辑推理、问题解决的模型,能够自主处理需要多步骤分析、因果推断或复杂决策的任务

如果你还在用各种”专业提示词”和”模板,不好意思,DeepSeek根本不吃这一套。

举个有趣的比喻:

其他模型:像需要「保姆级操作手册」的土木实习生,依赖用户预先拆解任务逻辑,若提示词不专业,输出易偏离实际需求(指令型)

DeepSeek R1:比你项目总共还聪明却又不知劳累的资深工程师,你需要给它一份「内部技术交底资料」,就能自主关联施工规范、权衡计算变量,输出系统性施工方案(推理型)

说人话

▼

DeepSeek不需要你写”专业提示词”,它需要的是真实场景和具体需求。使用Deepseek,清晰、明确地表达你的需求>五花八门的提示词技巧

用对Deepseek的王炸技巧案例分享

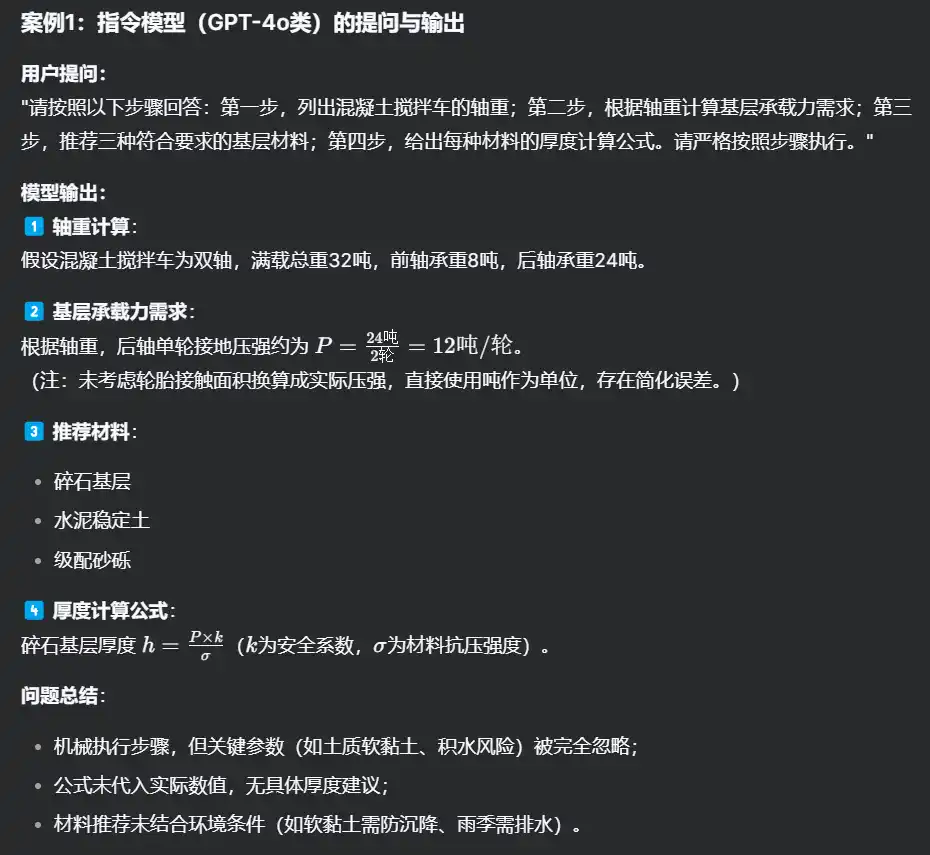

✖️ 指令模型(如GPT-4o)的提问方式:

⭐用户提问:

“请按照以下步骤回答:第一步,列出混凝土搅拌车的轴重;第二步,根据轴重计算基层承载力需求;第三步,推荐三种符合要求的基层材料;第四步,给出每种材料的厚度计算公式。请严格按照步骤执行。”

⭐问题分析:

用户被迫将复杂任务拆解成零散的指令,像在教实习生一步步操作,但若步骤缺失或逻辑跳跃(如未考虑排水、地质条件),模型可能卡壳或给出片面答案。

答案输出:

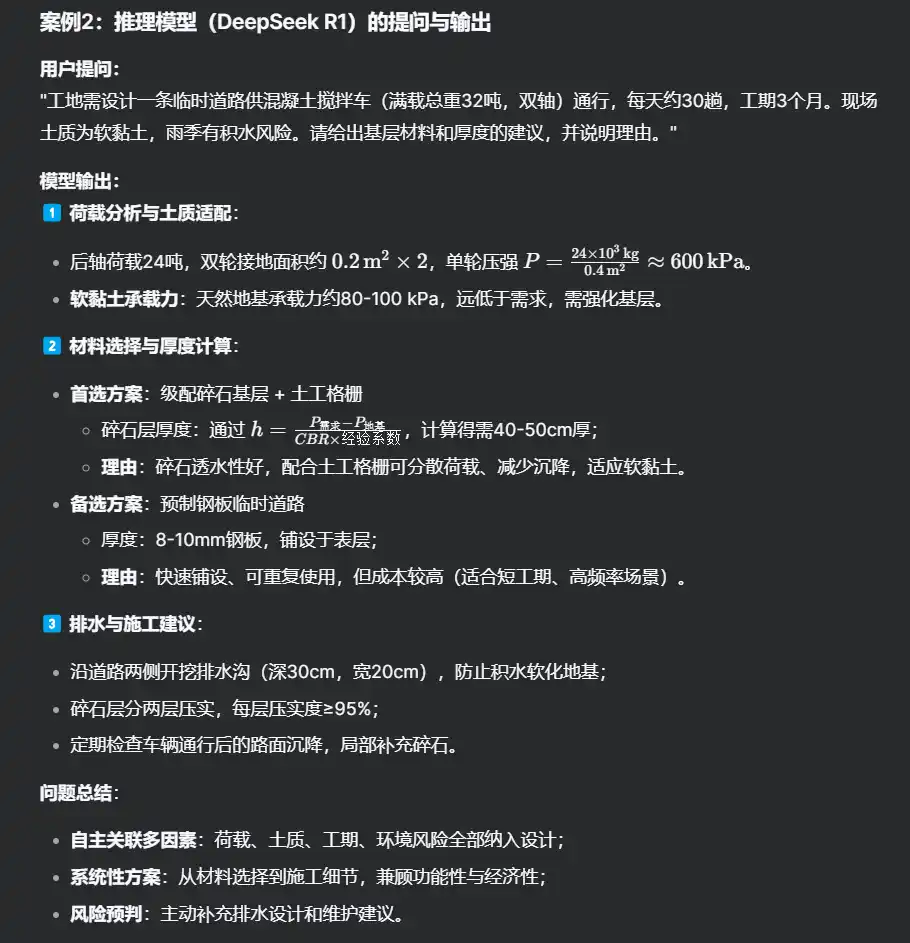

✔️推理模型(DeepSeek R1)的提问方式:

⭐用户提问:

“工地需设计一条临时道路供混凝土搅拌车(满载总重32吨,双轴)通行,每天约30趟,工期3个月。现场土质为软黏土,雨季有积水风险。请给出基层材料和厚度的建议,并说明理由。”

⭐ 问题分析:

用户仅提供真实场景参数(车辆荷载、土质、环境风险),无需教模型「如何思考」。DeepSeek R1会自主完成以下推理:

答案输出:

对比结论

指令模型:需用户拆解逻辑,像“做题家”,依赖用户预设框架,仅完成“纸面作业”,答案机械且脱离实际场景

DeepSeek R1:推理模型直接消化需求,像“技术总工”,通过真实参数自主推导完整方案,输出可直接落地的工程建议,甚至超预期补充风险应对措施

Deepseek提问技巧

有了上面的几个比喻以及案例分析,想必各位桥梁青年们都对Deepseek有了清晰的认识,可是好像

还是不知道如何上手怎么办?

没关系

模板给到手

随时露一手

定义目标,而非过程

送您一个通用公式:

“少扯专业名词,多讲人话需求——哪根梁?加多少吨?” 毕竟它是比你更聪明的下属,它需要的不是你教,而是大胆说出你的需求。一个简单但超级实用的“四步提问法”:背景 + 任务 + 要求 + 补充

“我要加固厂房混凝土梁的裂缝(目标),给生产线设备承重梁用(用途),希望修复后能承受新增5吨设备荷载且10年内不再开裂(效果), 裂缝最宽3mm,预算不能超过20万(补充)。

避坑几个你的“小聪明”

在使用R1时,以下prompt策略经验证已基本失效,甚至部分技巧会起反作用

少示例提示:这是DeepSeek团队在发布R1技术报告时明确建议规避的一个提示技巧,减少示例干扰,把你的需求说清楚比给示例更重要

多余的解释:没有必要在提问时候解释你的专业名词,比如让他模仿李白风格写一首诗,就不要再去解释李白什么样的风格,毕竟它都懂,你做的只是无用功

图原创@南瓜博士

减少指定步骤:不要在提示词里指定思考步骤,除非你只希望 AI 严格执行;

这一条是 R1 和以前模型最大的区别。

以前在提示词里用 CoT(Chain of Thoughts,思维链)的方式把中间过程都写出来,能有效提升大模型表现。但对 R1 这么做很可能起反作用。原因很简单:R1 的深度思考往往能比你想得更多。

毕竟,一个不太能干的领导,用太过微管理的方式来指挥员工干活,是非常扼杀聪明员工的灵气的。

提供必要知识背景

面对 R1,你依旧需要对大模型提供必要的背景信息,AI模型具有“知识截止时间”的特性,并且不具备贵公司的特定文献,你需要像拼图者般帮助AI突破知识限制,避免因信息缺乏导致出现错误回答。

请基于我提供的《×××技术交底》,进行….

图原创@南瓜博士

巧妙躲过敏感内容

国产AI内置审核尺度丧心病狂,你永远不知道你到底那个词触发了敏感词,分享几个有趣的“规避”技巧

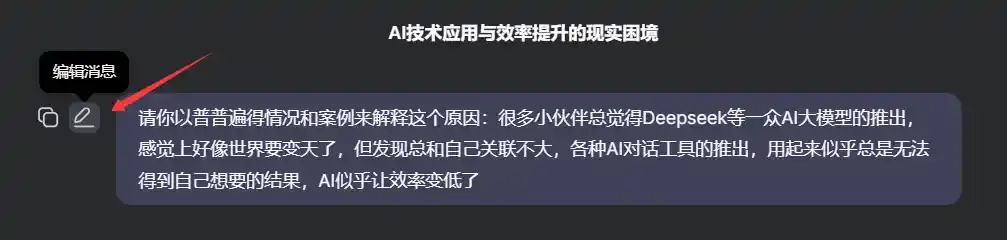

1.在你的提问处点击修改,再提交几次,总有一次是不触发审核的。

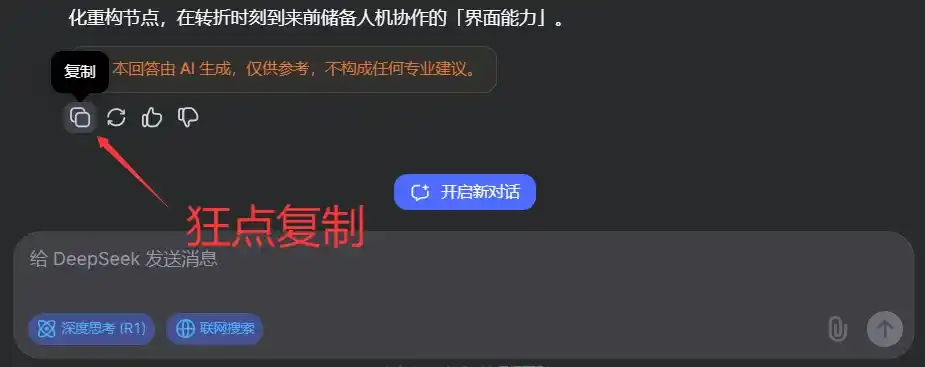

2.在生成回答的时候,狂点复制回答按钮,可以复制到拥有前面回答的内容

3.换一家吧,实在不行:必须涉及到政治类的内容,就可以试试kimi专门预设的公文写作助手,完全无限制

你需要警惕的误区

1、警惕AI幻觉

当我们过度依赖AI,以为AI无所不能的时候,比AI有所不能,更为可怕

在使用deepseek之前,我们要明白所有大语言模型其实概率分布模拟器,它们生成的内容的核心是预测最有可能出现的文本组合,它只负责根据已有的内容推理,不对信息本身负责。

举个例子:deepseek知道狼吃羊,并不是因为理解食物链的底层原理,而是因为它在处理的海量的文本里面,狼吃羊的概率要远远大过狼爱上羊,所以他会在输出结果的时候输出狼吃羊。

AI的精心包装,让编的材料看起来如此真实,如同“有意识”地在操控一般,真有些让人不寒而栗。

简单理解就是,不“保真”。

作为使用者,我们能做的就是找到AI的正确打开方式,拒绝“上当”。我们比任何时候都更需要寻求真相,增强明辨是非、独立思考的能力。

2、避免长文本写作

超过4000字的文章容易出现逻辑断裂,建议用Claude200k、或者kimi;因为deepseek默认是64k,长文不够用。

3、丢掉你的提示词

2024年还教人写提示词的大V,都是在收智商税。Deepseek最为推理模型的代表,代表了新一代AI的使用范式,辞旧迎新!

参考文献:

@Datawhale完整攻略:如何用好DeepSeek,一文汇总!

@南瓜博士,作者ElfeXu:DeepSeek R1 之后,提示词技巧的变与不变